A maioria das decisões de SEO é tomada com base em opinião.

Alguém leu um estudo de caso. Alguém ouviu em um podcast. Alguém testou em outro site, em outro nicho, em outro momento. E essa informação vira verdade absoluta dentro da estratégia, sem nenhuma validação no contexto específico do negócio.

O problema não é que as pessoas sejam descuidadas. É que SEO foi construído culturalmente como uma disciplina de “melhores práticas” e não como uma disciplina experimental. Você aplica o que os especialistas recomendam e espera que funcione.

Esse modelo tem uma falha fundamental: o Google não é um sistema estático, os nichos têm comportamentos diferentes e o que funciona para um site pode não funcionar para outro.

A solução é tratar SEO como uma disciplina experimental, com hipóteses testáveis, metodologia rigorosa e decisões baseadas em evidências do seu próprio site.

Por que testar em SEO é diferente de testar em outros canais

Em tráfego pago, testar é relativamente simples. Você cria duas versões de um anúncio, divide o tráfego igualmente entre elas, espera volume suficiente e mede qual converte melhor. O ambiente é controlado, os resultados são rápidos e a atribuição é clara.

Em SEO, nada disso se aplica da mesma forma.

Você não controla quem visita cada página. O Google atualiza seu algoritmo continuamente, o que significa que mudanças de posição podem refletir a sua alteração ou uma atualização do algoritmo, e distinguir um do outro não é trivial. Os resultados levam semanas ou meses para se manifestar. E isolar variáveis é extremamente difícil porque cada página tem dezenas de fatores que interagem entre si.

Apesar dessas limitações, testar em SEO é possível, e os resultados de experimentos bem desenhados têm um valor que nenhuma “melhor prática” genérica consegue substituir: eles refletem a realidade do seu site, do seu nicho e do seu momento competitivo.

Os tipos de experimentos em SEO

Testes de série temporal

É o formato mais comum em SEO. Você faz uma alteração em uma página ou conjunto de páginas, registra o momento exato da alteração e acompanha o comportamento das métricas ao longo do tempo.

A lógica é simples: se as métricas melhoraram consistentemente após a alteração e nenhum outro fator relevante mudou no mesmo período, a alteração provavelmente contribuiu para a melhora.

O principal risco desse formato é a confusão de causalidade. Atualizações de algoritmo, sazonalidade, mudanças no comportamento dos concorrentes e variações de tráfego naturais podem criar a ilusão de que a sua alteração funcionou (ou não funcionou) quando a causa real é outra.

Como mitigar: sempre registre as datas de alterações do Google (o Search Status Dashboard e o MozCast são referências úteis) e compare o comportamento das páginas alteradas com páginas de controle no mesmo período.

Testes A/B em SEO (split testing)

Em vez de alterar todas as páginas de uma vez, você divide páginas similares em dois grupos: o grupo de tratamento, que recebe a alteração, e o grupo de controle, que permanece sem mudança. Você compara o desempenho dos dois grupos ao longo do tempo.

Esse formato é mais robusto do que a série temporal simples porque o grupo de controle absorve o efeito de fatores externos como atualizações de algoritmo e sazonalidade. Se o algoritmo mudar durante o teste, afeta os dois grupos igualmente, e a diferença entre eles ainda reflete o efeito da sua alteração.

Para executar um teste A/B em SEO, você precisa de:

Páginas suficientes para criar grupos estatisticamente válidos. O número ideal depende do tráfego, mas trabalhar com menos de 20 páginas por grupo geralmente produz resultados não confiáveis.

Páginas similares entre os grupos. Comparar páginas de produto com páginas de blog invalida o teste. Os grupos precisam ter características parecidas em termos de tipo de conteúdo, volume de tráfego e autoridade.

Um período de observação longo o suficiente. Em SEO, duas a quatro semanas raramente são suficientes. Oito a doze semanas é um horizonte mais realista para mudanças de posição se manifestarem.

Ferramentas como o Search Console e o GA4 para medir os resultados nos dois grupos de forma comparável.

Testes de reversão

Você faz uma alteração, observa o resultado por um período, desfaz a alteração e observa se o comportamento reverte. Se a métrica melhorou com a alteração e piorou com a reversão, a evidência de causalidade é mais forte do que em um teste simples de série temporal.

Esse formato é especialmente útil para validar hipóteses sobre mudanças negativas. Se uma página perdeu posições, você pode reverter a última alteração feita e observar se a posição se recupera.

Testes de rollout gradual

Em vez de aplicar uma mudança em todas as páginas de uma vez, você aplica em um subconjunto primeiro, observa o resultado e só então expande para o restante do site. Esse formato reduz o risco de mudanças que podem prejudicar o desempenho do site inteiro antes que você perceba o problema.

O que testar em SEO

Nem tudo vale o esforço de um experimento formal. Algumas alterações têm impacto previsível e documentado o suficiente para serem implementadas sem teste. Outras têm impacto incerto o suficiente para justificar uma abordagem experimental.

Títulos e meta descriptions

É uma das variáveis mais testáveis em SEO porque o impacto é relativamente rápido (CTR muda em dias, não semanas) e a atribuição é clara. Você pode testar:

Diferentes formatos de título (pergunta vs. afirmação vs. lista) Inclusão ou exclusão de números (“7 formas de…” vs. “Como…”) Posicionamento da palavra-chave (início vs. meio do título) Inclusão de elementos de urgência ou especificidade na meta description

O Search Console mostra impressões, cliques e CTR por página, o que torna a medição direta.

Estrutura de headings

Como a hierarquia de H1, H2 e H3 afeta o ranqueamento para palavras-chave secundárias? Testar variações na estrutura de headings em páginas similares pode revelar padrões relevantes para o seu nicho específico.

Comprimento e profundidade do conteúdo

Para uma determinada categoria de palavras-chave, conteúdo mais longo e detalhado ranqueia melhor do que conteúdo mais conciso? A resposta varia por nicho, por intenção de busca e pelo nível de competição. Testar é a única forma de saber com certeza para o seu contexto.

Frequência de atualização de conteúdo

Atualizar conteúdo existente com regularidade tem impacto mensurável no ranqueamento para aquele site e nicho? Crie um grupo de páginas que você atualiza mensalmente e compare com um grupo de controle que permanece estático.

Linkagem interna

Adicionar links internos contextuais para páginas prioritárias aumenta o ranqueamento dessas páginas? Esse é um dos experimentos mais valiosos e menos executados em SEO. O impacto da linkagem interna é real, mas a magnitude varia significativamente entre sites.

Dados estruturados (schema markup)

Adicionar marcações de schema para um conjunto de páginas aumenta o CTR ou a posição média comparado a páginas sem schema? O impacto pode ser medido tanto em rich results (que aparecem diretamente na SERP) quanto em comportamento geral.

Velocidade de carregamento e Core Web Vitals

Melhorar o LCP ou o CLS de um grupo de páginas tem impacto mensurável no ranqueamento comparado a páginas similares sem otimização? Esse teste é especialmente relevante para sites onde os Core Web Vitals estão na faixa de “precisa melhorar”.

Como estruturar um experimento de SEO

Um experimento mal estruturado pode produzir conclusões erradas que prejudicam a estratégia por meses. A estrutura correta começa antes de qualquer alteração.

Passo 1: defina a hipótese com precisão

Uma boa hipótese de SEO tem três componentes: a alteração específica que será feita, a métrica que será medida e a direção esperada do efeito.

Exemplo de hipótese ruim: “Vou melhorar os títulos e ver o que acontece.”

Exemplo de hipótese boa: “Incluir um número específico no início do título das páginas de categoria de produto vai aumentar o CTR médio dessas páginas em pelo menos 10% em oito semanas.”

A especificidade da hipótese força clareza sobre o que você está testando e o que você considera um resultado positivo.

Passo 2: identifique as páginas de tratamento e controle

Selecione as páginas que receberão a alteração (tratamento) e as páginas que permanecerão sem mudança (controle). Os dois grupos devem ser o mais similares possível em tipo de conteúdo, volume de tráfego e posição média atual.

Se você tem 100 páginas de blog com características similares, divida-as em dois grupos de 50 de forma aleatória. Aplique a alteração em um grupo. Observe ambos.

Passo 3: registre o baseline

Antes de qualquer alteração, registre as métricas atuais de todas as páginas envolvidas: posição média, impressões, cliques, CTR, dwell time, taxa de engajamento. Esse baseline é o ponto de comparação para avaliar o impacto.

Passo 4: faça a alteração e registre a data exata

Altere as páginas do grupo de tratamento em um único momento. Registre a data e hora exatas. Qualquer análise posterior vai usar essa data como referência.

Passo 5: defina o período de observação antes de começar

Não olhe para os resultados toda semana e decida interromper o teste quando parecer positivo ou negativo. Defina o período de observação antes de começar (oito semanas, doze semanas) e respeite esse prazo. Análises prematuras são uma das principais fontes de conclusões erradas em experimentos de SEO.

Passo 6: analise com contexto

Ao final do período, compare o desempenho do grupo de tratamento com o grupo de controle. Verifique se houve atualizações de algoritmo relevantes no período. Verifique se há variações sazonais que podem explicar diferenças. Analise o delta entre os grupos, não os números absolutos isoladamente.

Passo 7: documente e compartilhe

O valor de um experimento não está apenas no resultado imediato. Está na base de conhecimento que ele constrói. Documente a hipótese, a metodologia, as páginas envolvidas, o período, os resultados e as conclusões. Isso permite que futuras decisões sejam informadas pela história de experimentos do site, não apenas por opiniões externas.

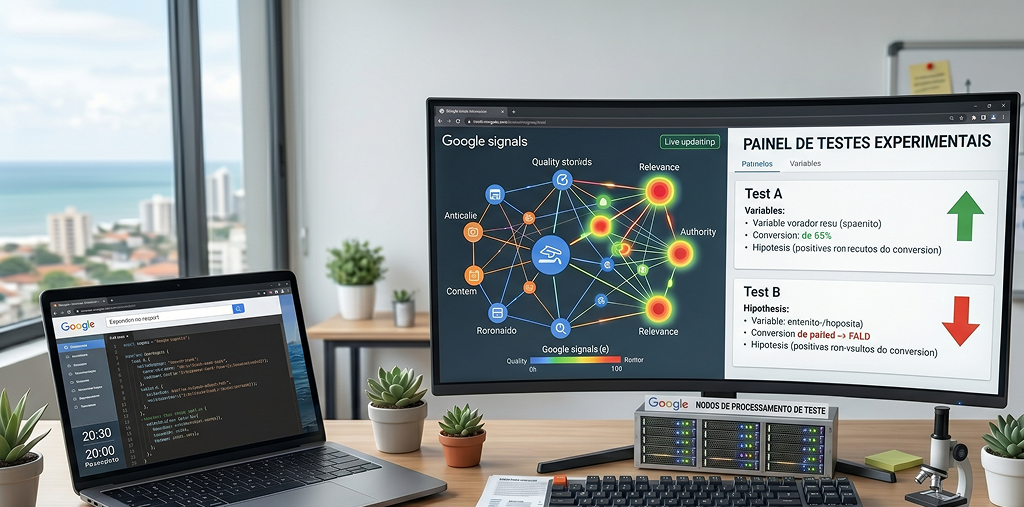

Ferramentas para testes de SEO

Google Search Console: imprescindível para medir impressões, cliques, CTR e posição média por página e por consulta. O relatório de desempenho permite filtrar por datas e comparar períodos.

GA4: para métricas comportamentais como tempo de engajamento, profundidade de sessão e taxa de engajamento por página de entrada orgânica.

SEOTesting.com: ferramenta dedicada a testes de SEO que facilita a criação de grupos de tratamento e controle e a análise estatística dos resultados.

SplitSignal (Semrush): plataforma de split testing para SEO que automatiza parte da estrutura experimental e usa análise estatística para validar resultados.

Screaming Frog: para auditar e monitorar as alterações feitas nas páginas de tratamento e garantir que foram implementadas corretamente.

Google Sheets ou Notion: para documentar hipóteses, registrar baselines e acompanhar o progresso de cada experimento.

Os erros mais comuns em experimentos de SEO

Testar sem hipótese clara: alterar coisas e ver o que acontece não é um experimento. É exploração sem metodologia. Os resultados são difíceis de interpretar e impossíveis de replicar.

Interromper o teste cedo: o impulso de olhar os resultados após duas semanas e tirar conclusões é fortíssimo. Resista. SEO tem latência. Mudanças de posição levam semanas para se consolidar, e avaliar antes disso produz conclusões enganosas.

Confundir correlação com causalidade: a posição melhorou depois da alteração. Mas o que mais aconteceu nesse período? Houve uma atualização de algoritmo? Um concorrente caiu? A sazonalidade ajudou? Sem grupo de controle, é impossível isolar o efeito da sua alteração.

Testar muitas variáveis ao mesmo tempo: se você alterou o título, adicionou schema e melhorou o LCP ao mesmo tempo, e o resultado foi positivo, você não sabe qual alteração causou a melhora. Teste uma variável por vez ou aceite que os resultados serão ambíguos.

Não documentar: um experimento que produziu resultados mas não foi documentado tem vida útil igual à memória de quem o conduziu. Em seis meses, a mesma hipótese vai ser testada de novo, com o mesmo esforço, porque ninguém se lembra do que foi aprendido.

Ignorar o tamanho da amostra: testar em três páginas não produz resultados estatisticamente confiáveis. O número mínimo de páginas por grupo depende do volume de tráfego e da magnitude do efeito esperado, mas grupos pequenos quase sempre produzem conclusões não generalizáveis.

Construindo uma cultura de experimentação em SEO

O maior benefício de testar sistematicamente em SEO não é o resultado de um experimento específico. É a mudança de mentalidade que acontece quando uma equipe passa a tratar hipóteses como hipóteses e não como verdades.

Quando alguém diz “deveríamos adicionar FAQ schema em todas as páginas de serviço”, a resposta deixa de ser “sim, é uma boa prática” e passa a ser “vamos testar em um grupo e medir o impacto antes de escalar”.

Quando uma página perde posições, a resposta deixa de ser “provavelmente foi uma atualização do Google” e passa a ser “quais alterações foram feitas nessa página no último mês e como podemos isolar a causa”.

Quando uma nova técnica aparece no mercado, a resposta deixa de ser “todo mundo está fazendo, vamos implementar” e passa a ser “vamos testar no nosso site antes de comprometer recursos”.

Essa mudança de mentalidade é o que separa equipes de SEO que crescem de forma consistente das que oscilam sem entender por quê.

Conclusão: a vantagem competitiva de quem testa

O mercado de SEO está cheio de opiniões. Artigos, podcasts, conferências e consultores oferecem um volume interminável de “melhores práticas” e “estratégias comprovadas”.

A maioria dessas recomendações é genérica. Pode funcionar em muitos contextos. Pode não funcionar no seu.

Empresas que constroem uma cultura de experimentação em SEO acumulam algo que nenhum artigo externo pode oferecer: conhecimento específico sobre o que funciona no seu site, no seu nicho, para o seu usuário, neste momento competitivo.

Esse conhecimento é proprietário. Não está disponível para os concorrentes. E ele se acumula a cada experimento documentado, criando uma vantagem que cresce com o tempo.

Testar não é mais lento do que não testar. É mais inteligente. E no longo prazo, é o que separa crescimento orgânico sustentável de apostas repetidas no escuro.